Au-delà de l’apprentissage : l’intelligence artificielle hybride

Couplage de l’apprentissage automatique à la simulation physique – Mouadh YAGOUBI et Milad LEYLI-ABADI (IRT SystemX)

La simulation physique représente aujourd’hui un outil incontournable dans la conception des systèmes physiques complexes. Récemment, les modèles physiques hybridés avec les techniques d’apprentissage ont gagné en intérêt grâce à leur capacité à améliorer le compromis coût/qualité des simulations. Cependant, la validation de ces systèmes hybrides reste un défi important et nécessite de mener des études comparatives pour la prise de décision. La plateforme de benchmarking LIPS propose une architecture modulaire et configurable afin de répondre à ce besoin et offre à l’utilisateur un panel de critères d’évaluation pour comparer plusieurs simulateurs hybrides. Deux cas d’usage industriels traitant des physiques différentes ont déjà été testés sur la plateforme LIPS et d’autres cas physiques sont en cours d’investigation comme l’étude des déformations des pneus (Michelin) reposant sur une méthode hybride couplant un modèle mécanique et un modèle d’apprentissage automatique pour simuler en 3D un pneu roulant.

Figure 1 : Schéma général du Framework LIPS

Nook, une premier mondiale pour une IA hybride* – Jean-Baptiste FANTUN (Nukkai)

À la différence de jeux comm les échecs ou le Go, le bridge est un jeu à information incomplète : chaque joueur ne connaît au départ que les 13 cartes qu’il a en main. Au cours de la partie, en raisonnant sur les informations transmises pendant la phase des enchères et sur les cartes jouées à chaque pli, chaque joueur restreint ses hypothèses sur les cartes restant en jeu. Bien jouer au bridge implique de maîtriser différentes compétences :

- Faire des déductions : si tel joueur a joué telle séquence de coups, il a ou n’a pas telle carte ;

- Émettre et réviser des hypothèses : tel adversaire a au moins cinq cartes à Pique ou n’a plus de cartes à Coeur ;

- Anticiper un certain nombre de coups probables de l’équipe adverse ;

- Évaluer les probabilités des différentes mains adverses possibles pour guider la prise de risque et calculer l’espérance de gain des coups à jouer.

L’intelligence artificielle Nook créée par la start-up NukkAI, hybride car tirant parti de la force combinée d’approches d’IA symbolique et de techniques d’IA numérique, a réussi le 25-26 mars 2022 à surpasser le niveau de huit champions de bridge de niveau mondial sur plusieurs centaines de parties avec le même contrat à réaliser : trois Sans Atout. Cette IA a été aussi appliquée dans de nombreux domaines comme la finance, la cybersécurité, l’éducation et la défense.

*Cet article est inspiré de la publication de Marie-Christine ROUSSET

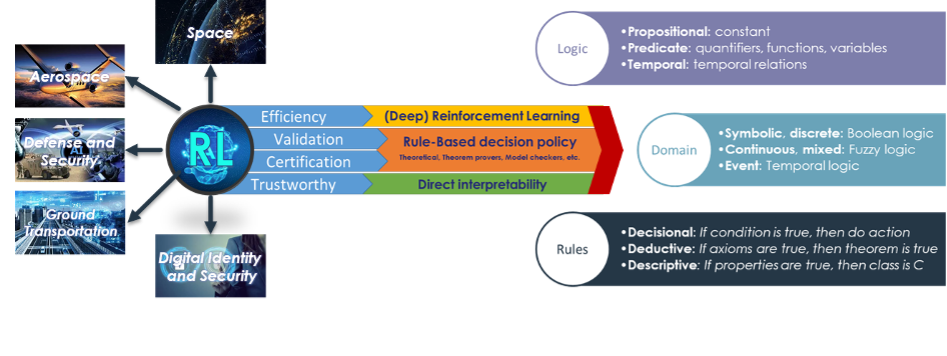

Apprentissage par renforcement interprétable par conception – Nicolas MUSEUX (Thales)

L’automatisation de systèmes d’aide à la décision, pour lesquels la décision est récurrente et dépendante de l’état d’une situation courant, est une tâche difficile que l’apprentissage par renforcement (RL) traite de plus en plus efficacement. Néanmoins, ce gain en performance se fait au détriment de la validation prouvée et de la certifiabilité pourtant nécessaires pour un usage dans des systèmes critiques. Notre recherche s’intéresse à allier l’efficacité des techniques de RL avec les prédispositions d’interprétrabilité, de validité, voire de certifiabilité, de méthodes d’IA symbolique reposant sur la logique mathématique. L’objectif est donc de concevoir une politique de décision par apprentissage par renforcement directement sous la forme d’une base de règles et ce, en fonction du type de décision (production, déduction), du domaine de valeurs (continu, discret, symbolique) et de la logique attendue (proposition, prédicat, floue, temporelle).

Figure 2 : Hybridation IA connexionniste et IA symbolique pour des systèmes critiques de confiance

Une première étude de cas a été réalisée pour l’apprentissage d’une politique de défense tactique pour la protection de zone.

Conclusion

La validité, l’explicabilité, la sécurité et la responsabilité sont des prérequis pour aller vers l’homologation voire la certification d’un système à base d’IA. Pour cela, il est nécessaire d’apporter des garanties permettant une utilisation dans les domaines considérés comme critiques. Malgré les récentes améliorations apportées aux algorithmes d’apprentissage automatique, ces défis restent encore difficiles à atteindre. Il y a deux raisons à cela :

- L’IA dirigée par les données manque de transparence, d’interprétabilité et de robustesse.

- L’IA symbolique repose sur des représentations de connaissances et un raisonnement symbolique pas toujours robuste face aux incertitudes.

Pour pallier les faiblesses de chacune de ces approches, l’IA hybride s’appuie sur les avancées des méthodes connexionnistes en y intégrant autant que possible toute connaissance disponible (expertise métier, connaissances physiques, mathématiques, etc.) lors de l’élaboration des modèles d’IA et cela pour en faciliter l’interprétabilité, garantir la robustesse et permettre ainsi la validation des systèmes pour leur homologation voire certification. La DARPA (Defense Advanced Research Projects Agency) a d’ailleurs lancé le programme « Assured Neuro Symbolic Learning and Reasoning » (ANSR) pour relever ces défis sous la forme de nouveaux algorithmes d’IA hybrides (neuro-symboliques) qui intègrent profondément le raisonnement symbolique à l’apprentissage basé sur les données afin de créer des systèmes robustes, sûrs et donc dignes de confiance.